Remote Control Rolling Chassis

Das FlexCar Project ist ein von Daimler durchgeführtes Innovationsprojekt in der Arena 2036 Stuttgart-Vaihingen. Hierbei wurde ein elektrisch angetriebener Unterbau - das “Rolling Chassis” - entwickelt, welches mit unterschiedlichen Sensortechniken ausgestattet ist. Ziel dieses Projektes ist, das Chassis per Remote-Steuerung vollständig und automatisiert in Bewegung zu bringen und mit dem Einsatz von Virtual Reality Techniken ein reales Fahrerlebnis zu generieren.

Beschreibung

Im Rahmen des Moduls “Mobile Applications” von Herr Prof. Dr. Ansgar Gerlicher wird eine mobile Applikation entwickelt, welche in zukunft die Remote-Steuerung des Rolling Chassis ermöglicht. Da sich das Rolling Chassis sich derzeit noch in einer prototypischen Entwicklungsphase befindet, kann es aufgrund noch fehlender Sicherheitssysteme nicht in Betrieb genommen werden.

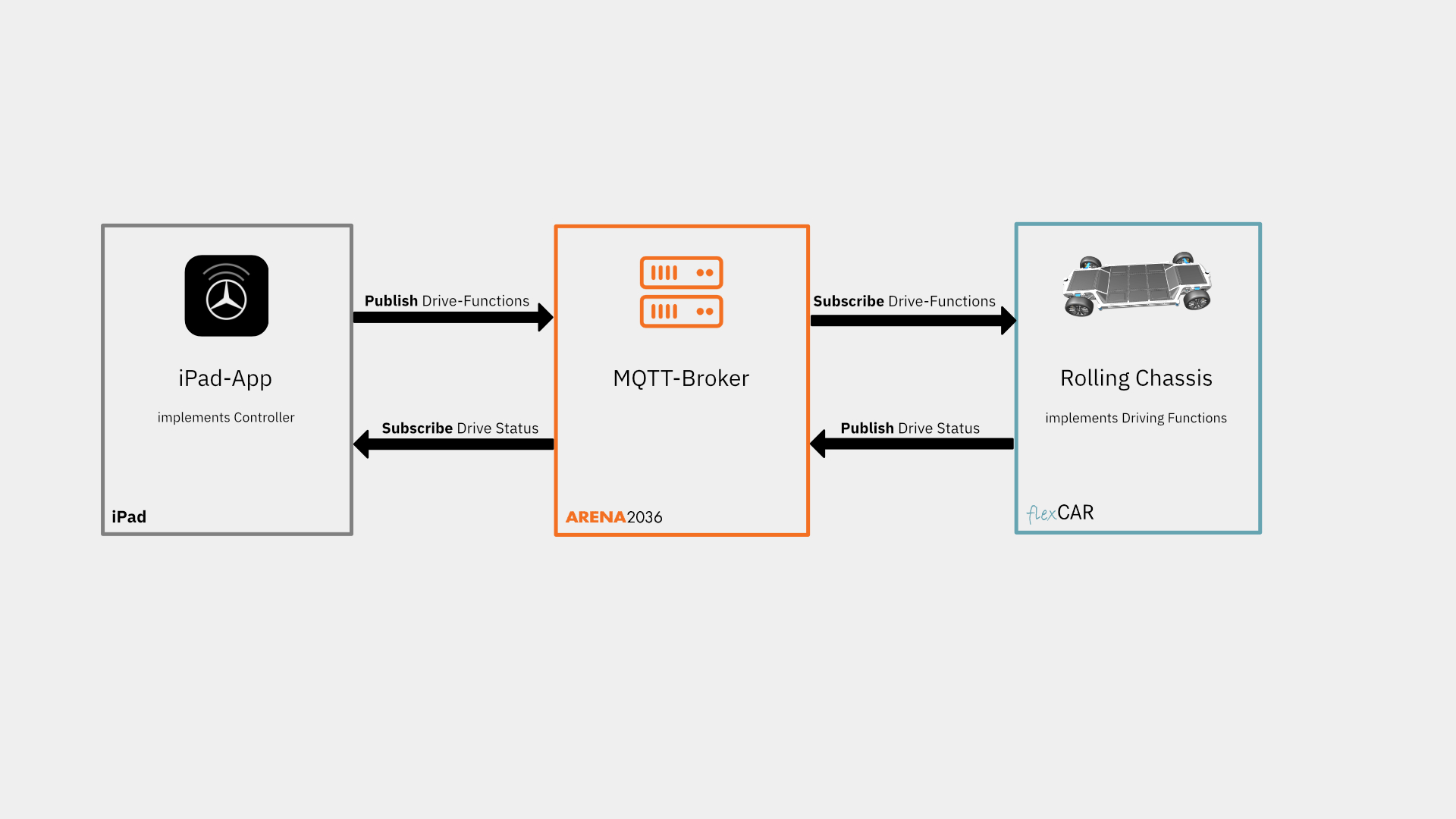

Aus diesem Grund wird die mobile Applikation derzeit anhand eines Modellnachbaus in Miniaturform entwickelt und getestet. Hierbei wurden die wichtigsten Elemente wie Antrieb, Lenkfunktion und einer Kamera implementiert. Ziel dieses Projektes ist, das Modell-Chassis per iPad-Applikation vollständig steuern zu können und dabei einen 180° Kamera Live-Stream anzeigen zu lassen. Umsetzt wird dies - wie auch im späteren FlexCar Projekt - mittels eines MQTT-Clients der sich auf dem Modellauto befindet. Der Client läuft derzeit auf einem Raspberry Pi, empfängt die Befehle der Applikation per W-Lan und wandelt diese in von dem Auto lesbaren Befehlscode um.

RollingChassis

Die Applikation wird vorerst nativ auf Basis von iOS umgesetzt und somit in Apple’s Programmiersprache Swift entwickelt. Sie beinhaltet die Grundfunktionen zur Steuerung des ModellChassis und einer Anzeige der darauf verbauten USB Front-Kamera. Die jeweiligen Joysticks der Applikation dienen zur Steuerung von Antrieb und Lenkung und werden für das spätere RollingChassis in Newtonmeter umgerechnet. Die Steuerung der Kamera wird über die eingebauten Gyro-Sensoren des iPad realisiert. Durch Neigen und Drehen des iPads kann sich somit der Benutzer mit der Kamera auf dem Chassis “umsehen”. Die Gyro-Sensoren werden ebenfalls für die “Not-Aus” Sicherheitsfunktion verwendet. Durch schütteln des iPad oder dem Aufprall nach einem Sturz wird der Antrieb des Chassis sofort auf 0 gesetzt.

Da derzeit lediglich eine Entwicklung anhand des ModellChassis möglich ist, liegt der Fokus der Applikation auf den Grundfunktionen zur Steuerung und einer stabilen Verbindung zwischen App und MQTT-Client. Die Applikation wird mit Hilfe von sog. Property-Files so entwickelt, dass nachträgliche Änderungen von MQTT-Topics oder Min- und Max-Werten für bspw. verfügbare Newtonmeter oder Lenkwinkel ohne Probleme möglich sind.

Aufgrund der aktuellen Corona-Einschränkungen ist es derzeit ebenfalls nicht möglich, das Projekt in Live-Form auf der MediaNight oder innerhalb der Arena 2036 zu demonstrieren. Aus diesem Grund folgt zum Abschluss des Projektes ein kurzes Dokumentationsvideo der finalen Ergebnisse.

Externe Links

Projektart

Projektarbeit

Semester

WS2020/2021

Beteiligte Studiengänge

Computer Science and Media (Master)

Team |

| Robin Deeg, Johannes Goss, Tobias Müller |

Betreuer |

| Ansgar Gerlicher |

Software

Adobe Illustrator

Xcode

Adobe Photoshop

After Effects

Programmierung

Python

Swift

MQTT